您现在的位置是:首页 > 财经 > 正文

Google使您可以更轻松地在手机上记录

发布时间:2021-05-21 10:14:55来源:

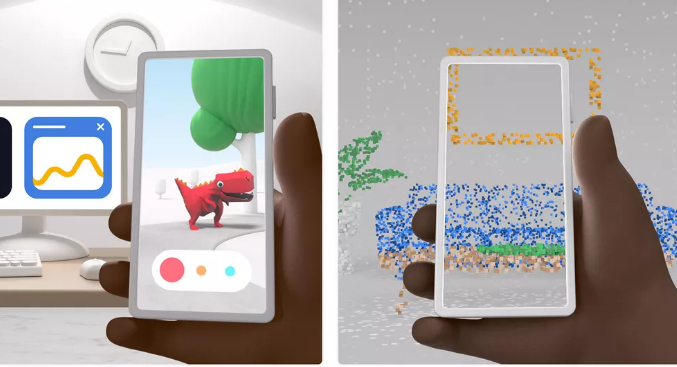

在今年Google的虚拟Google I / O开发者大会上,关于增强现实的新闻并不一定走在前列。但是该公司在Android上对其ARCore工具的更新看起来像是在增加一些与苹果的激光雷达相同的世界扫描功能-但没有激光雷达。并且,可以将AR叠加到预先录制的视频中。

根据Google的ARCore 1.24公告,这些新工具可用于与ARCore共享手机捕获的深度图:换句话说,就是物体在“ 3D网格”中的大致位置。根据Google在博客文章中宣布的合作伙伴应用程序,这些应用程序可用于3D扫描,或用于将物体(例如家具)实际放置在充满事物的房间中的AR。

在CNET的Google报表新闻中获取有关Google支持的设备的最新新闻,操作方法和评论。

更有趣(更令人弯腰)的部分是Google记录和共享深度图数据的能力,该公司将其构想为将AR放入预先录制的视频中的一种方式。如果某人已经具有某个房间的深度数据,则该房间的视频最终可能会使用该数据将对象作为效果放置到视频中,可能是社交视频(以TikTok为例)或其他任何地方。

使用ARCore在没有激光雷达的情况下将AR东西分层放置在深度扫描的椅子上。

据Google称,已经在尝试利用这些功能的合作伙伴应用包括:AR Doodads(将复杂的Rube Goldberg事物分层到房间中的应用),LifeAR(使用AR来投影化身的视频通话应用)和VoxPlop(在事实之后将3D效果分层到视频中)。

Google在一年前首次宣布了其深度感应增强现实功能,但现在,这是新的应用之间开放的深度数据共享。Google的帖子解释说:“这些更新利用了运动的深度,使它们可以在数亿个Android设备上使用,而无需依赖专门的传感器。” “尽管不需要诸如飞行时间(ToF)传感器之类的深度传感器,但使用它们可以进一步改善您的体验质量。”

尽管苹果目前依靠AR机房3D网格的物理传感器(激光雷达),但像Niantic这样的一些公司已经在做类似的事情而没有激光雷达。谷歌现在看起来也正在为Android扩展更多这些工具。

标签:

猜你喜欢

- 今日消息 内蒙古8月26日新增本土确诊病例5例、本土无症状感染者2例

- 今日消息 2022年中秋假期首日火车票明天开售

- 今日消息 美国8月消费者信心指数最终读数为58.2

- 今日消息 未达到回购方案下线且完成率较低,松炀资源及时任董事长遭上交所通报批评

- 今日消息 振东制药收半年报问询函:要求说明营收和净利润大幅下滑、扣非净利润亏损的原因

- 今日消息 美股开盘:美股三大指数涨跌不一,道指涨0.13%,中概股大涨

- 今日消息 江苏国泰:上半年归母净利润9.31亿元,同比增151.08%,汇兑收益约1.72亿元

- 今日消息 国药控股:上半年营收350亿元,同比增长14%

- 今日消息 美国7月商品贸易逆差初值891亿美元

- 今日消息 北京君正:上半年归母净利润同比增长43.94%

最新文章

- 今日消息 Meta旗下VR平台Horizon副总裁将离职,主要负责元宇宙相关研发

- 今日消息 天津昨日全域核酸检测结果已出,共发现20例核酸阳性感染者

- 今日消息 甘肃8月27日新增无症状感染者21例

- 今日消息 美国外卖平台DoorDash发生数据泄露事件,部分客户和司机信息被读取

- 今日消息 山东德州新增本土无症状感染者4例

- 今日消息 陕西8月27日新增本土确诊13例、无症状感染者44例

- 今日消息 内蒙古8月27日新增本土确诊病例4例、无症状感染者3例

- 今日消息 捷克众议院批准芬兰和瑞典加入北约

- 今日消息 浙江8月27日新增本土阳性1例,为社区筛查发现

- 今日消息 俄罗斯将开始为匈牙利扩建核电站

- 今日消息 江西8月27日新增本土无症状感染者24例

- 今日消息 河南8月27日新增本土确诊2例、无症状52例

- 今日消息 广东8月27日新增本土确诊12例、无症状4例、无症状转确诊1例

- 今日消息 新疆维吾尔自治区8月27日新增本土确诊4例、无症状57例

- 今日消息 北京文化:2022上半年净亏损收窄至2516万,营业成本同比减少98.32%

- 今日消息 黑龙江8月27日新增本土确诊病例1例、无症状7例

- 今日消息 重庆8月27日新增本土确诊12例、无症状7例

- 今日消息 海南8月27日新增本土确诊70例、无症状125例

- 今日消息 北京8月27日新增2例本土确诊病例、1例本土无症状感染者

- 今日消息 山西8月27日新增本土确诊病例9例、无症状感染者2例

- 今日消息 内蒙古二连浩特新增阳性感染者5人,全域继续实行静默管理

- 今日消息 天津西青多地调整为高、中风险区,精武镇、李七庄街实施全域静态管理

- 今日消息 山东8月27日新增本土无症状感染者2例

- 今日消息 西藏日喀则8月27日新增本土新冠病毒感染者144例